Vom Frontend-Bauer zum Maschinen-Architekten: Warum Sie jetzt mit uns Ihre eigene KI-Infrastruktur bauen müssen (und wie wir konkret helfen).

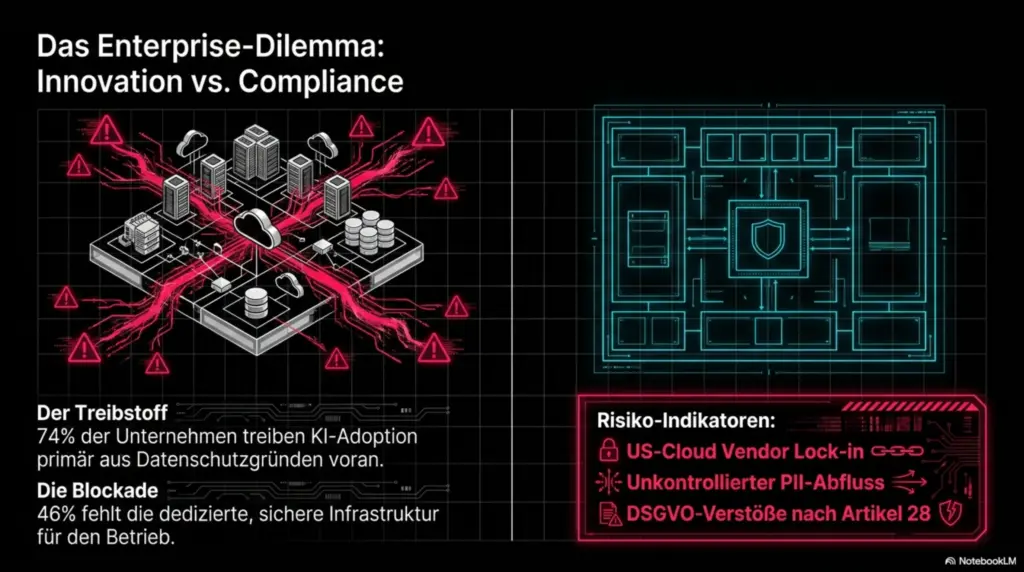

Die reine Generierung von Frontends und Webseiten verliert rapide an Wert. Wenn Sprachmodelle Benutzeroberflächen in Sekunden fehlerfrei schreiben, verschiebt sich der ökonomische Engpass auf die darunterliegende Architektur. Die Wertschöpfung verlagert sich auf die Bereitstellung massiver Rechenleistung, die Strukturierung von Daten, rechtssichere Umgebungen und permanente Laufzeiten.

Wir positionieren uns nicht als klassische Agentur für Webdesign. Wir sind Architekten der Infrastruktur, auf der die autonome KI Wirtschaft operiert.

Um die technische Tiefe und die exakte Systemarchitektur dieser Maschinebene zu visualisieren, haben wir ein dediziertes Interface im PRGRSV Terminal Design entwickelt. Dort sind alle Kernmodule und die technische Entscheidungsmatrix transparent aufgeschlüsselt.

Interaktive Systemarchitektur und Module planen

Hier sind unsere zentralen Dienstleistungen und Implementierungsangebote für Unternehmen im Detail.

Strategische Dienstleistungen im Überblick

| Modul | Fokus & Tech Stack | Ökonomischer Treiber | Konkretes Angebot |

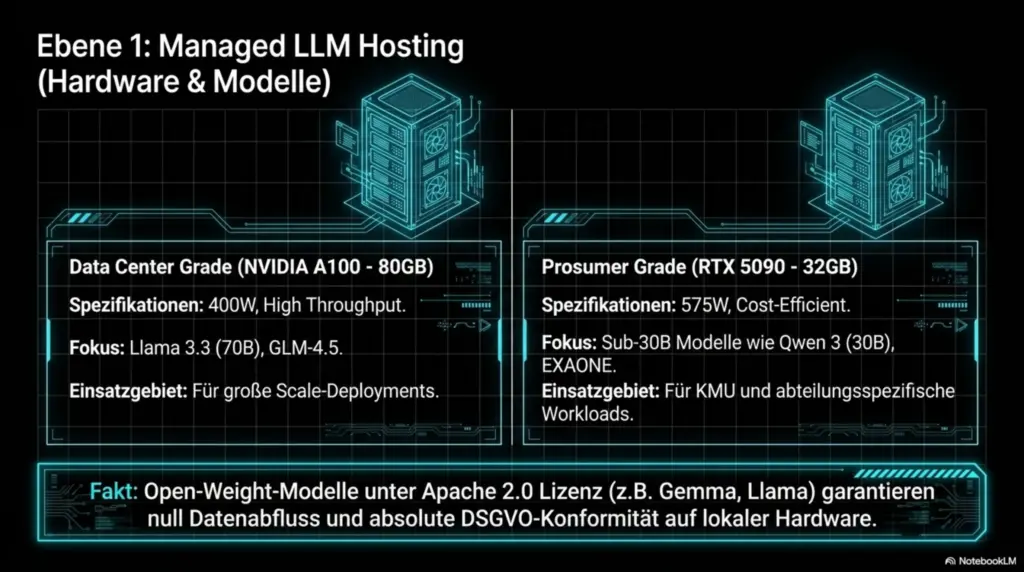

| Souveränes LLM Hosting | Dedizierte GPU Server, Docker, vLLM, Ollama | DSGVO Konformität, Schutz sensibler Daten, planbare Flatrate statt variabler API Kosten. | Setup und Wartung dedizierter lokaler Modelle auf Bare Metal. |

| RAG Pipelines & Vector DBs | Supabase, pgvector, Node.js, Web Scraping | KIs benötigen spezifische Unternehmensdaten. Wir wandeln unstrukturierte Daten in durchsuchbare Vektoren um. | Aufbau automatisierter Datenextraktion zur Speisung lokaler Wissensdatenbanken. |

| Agenten Orchestrierung | n8n, Plesk, API Gateways, Dauerläufer Skripte | Autonome Agenten erfordern 24/7 Laufzeiten, Systemsteuerung und fehlerfreie Operationen. | Bereitstellung hochverfügbarer und überwachter Serverumgebungen. |

| Edge AI via PWA | WebAssembly, WebGPU, Service Worker, lokales Caching | Cloud Inferenzkosten sind hoch. Lokale Ausführung auf Endgeräten senkt Kosten massiv. | Entwicklung performanter Progressive Web Apps mit lokalen KI Modellen. |

| KI API Caching & Tuning | Redis, Nginx Reverse Proxies, Lastenverteilung | KI API Aufrufe sind teuer und verursachen Latenzen. Aggressives Caching reduziert Cloud Rechnungen. | Implementierung von Caching Layern für wiederkehrende Prompts. |

| Hybrid Routing Gateways | LangChain, API Management, lokales Fallback | Intelligente Verteilung: Unkritische Anfragen an Cloud KIs, sensible Daten an lokale Server. | Konfiguration intelligenter Weichen zwischen On Premise und Cloud. |

Konkrete Implementierungsangebote

1. Das Souveränitäts Paket: Managed On Premise LLM

Unternehmen dürfen sensible Kundendaten häufig nicht an externe US Anbieter senden. Wir implementieren eine vollständig isolierte Infrastruktur auf dedizierten Servern.

- Leistungsumfang: Hardware Provisionierung von GPU Servern, Installation von vLLM oder Ollama sowie Anbindung via API an bestehende interne Systeme.

- Ergebnis: Volle Datenhoheit, DSGVO Compliance und absolute Kostenkontrolle ohne variable Token Abrechnung.

Infrastruktur Audit für lokales Hosting anfordern

2. Das Performance Paket: Edge AI und PWA

Durch die Verlagerung der Rechenlast von teuren Cloud Servern direkt auf die Geräte der Endnutzer entstehen performante und autarke Systeme.

- Leistungsumfang: Architektur und Programmierung einer Progressive Web App, Integration von WebAssembly und WebGPU sowie Bereitstellung kompakter KI Modelle für die lokale Inferenz im Browser.

- Ergebnis: Drastische Senkung der Serverkosten, vollständige Offline Funktionalität und minimale Latenzzeiten.

PWA Architekturplanung starten

3. Das Wissens Paket: RAG Pipeline Integration

Ein Basismodell kennt die internen Prozesse eines Unternehmens nicht. Wir bauen die Daten Architektur, die unstrukturierte Informationen für die KI nutzbar macht.

- Leistungsumfang: Aufbau einer performanten Scraping Infrastruktur für interne Dokumente und Datenbanken, Bereinigung, Implementierung einer Vektordatenbank und Anbindung an das Sprachmodell.

- Ergebnis: Eine KI, die ausschließlich, präzise und halluzinationsfrei auf Basis der eigenen Unternehmensdaten operiert.

Datenstukturierungs Analyse buchen

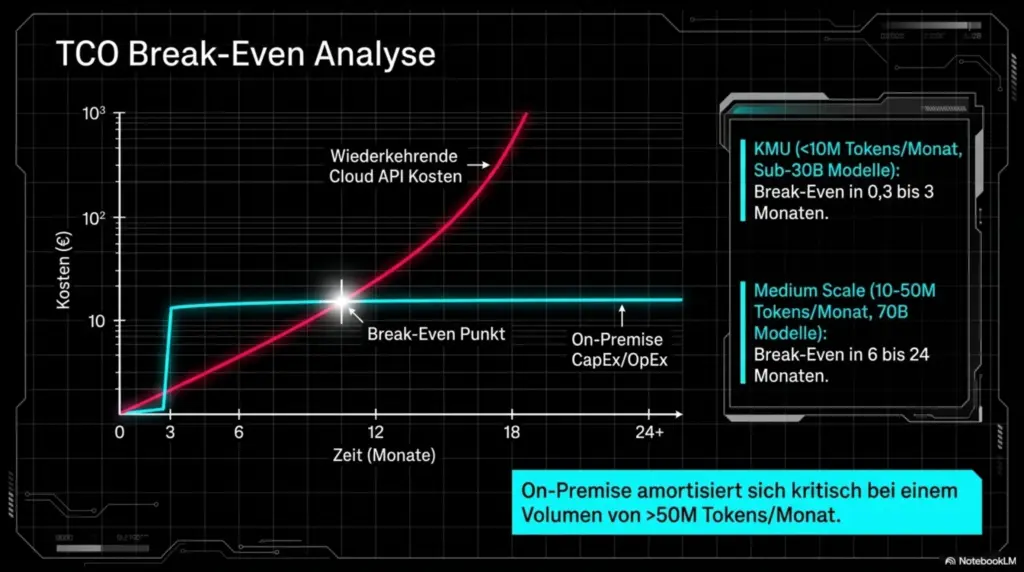

Infrastruktur Entscheidung: Bare Metal oder Cloud Orchestrierung

Wir setzen architektonisch primär auf eine Hybrid Strategie.

Für maximale DSGVO Souveränität, volle Kontrolle über Hardware Ressourcen und die absolute Vermeidung unvorhersehbarer API Kosten ist die dedizierte Bare Metal Infrastruktur zwingend erforderlich. Die initiale Setup Komplexität wird durch unsere Managed Services vollständig abgedeckt.

Für Aufgaben, die eine globale Skalierung auf Knopfdruck oder extrem komplexe Reasoning Tasks erfordern, nutzen wir Cloud Orchestrierung. Das von uns implementierte Hybrid Routing Gateway entscheidet in Echtzeit, welcher Weg für die jeweilige Systemanfrage der effizienteste, günstigste und sicherste ist.

Die Maschinebene ist das Fundament der nächsten technologischen Dekade. Wer jetzt die Infrastruktur baut, kontrolliert den Markt.